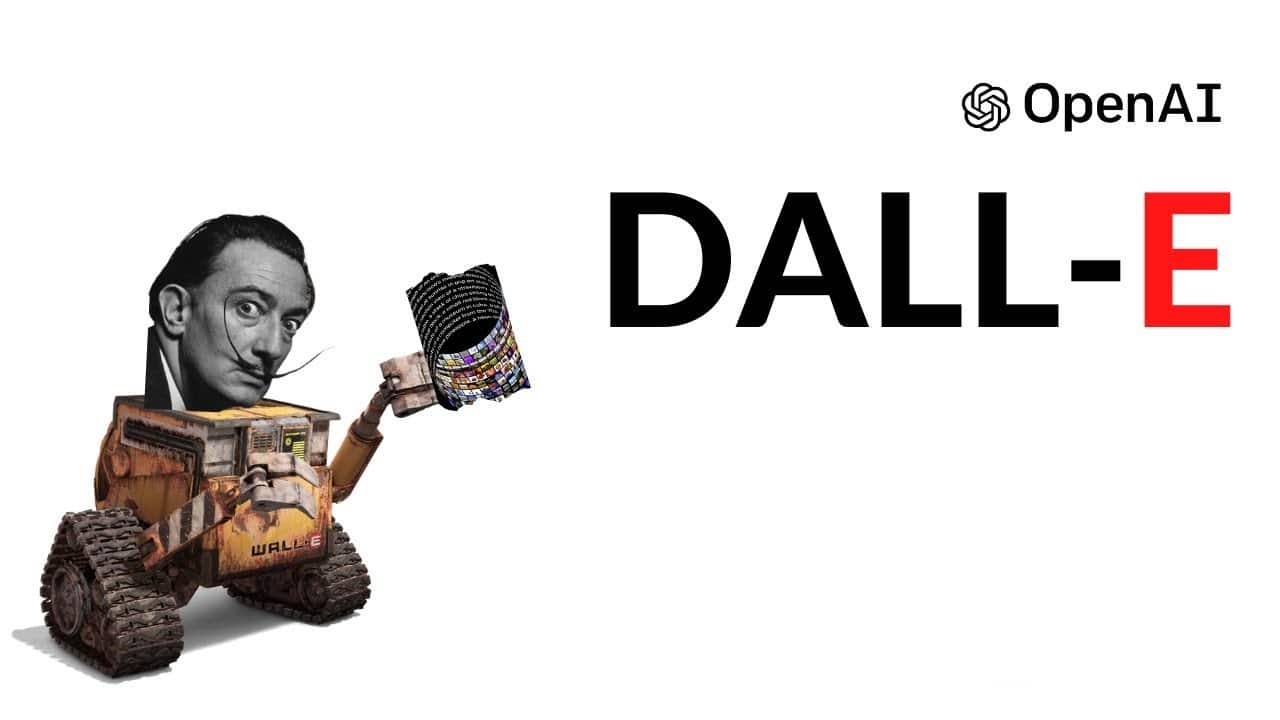

DALL-E 2, el sistema de inteligencia artificial de OpenAI ya esta disponible en versión beta

Hace pocos días OpenAI dio a concer que DALL-E 2, el sistema de inteligencia artificial de que puede generar imágenes a partir de un aviso o editar y refinar imágenes existentes, ya está disponible en version beta y que ademas acelerará el acceso de los clientes en la lista de espera con el objetivo de llegar al rededor de 1 millón de personas en las próximas semanas.

Con este lanzamiento «beta», DALL-E 2, que era de uso gratuito, pasará a una estructura de tarifas basada en créditos. Los nuevos usuarios obtendrán una cantidad limitada de créditos que se pueden usar para generar o editar una imagen o crear una variación de una imagen.

OpenAI anunció que invitaría a más personas a probarlo, pues planea dejar entrar hasta 1 millón de personas de su lista de espera durante las próximas semanas a medida que pasa de su fase de investigación a su fase beta.

No está claro si DALL-E alguna vez estará completamente disponible para el público, pero se espera que la expansión sea una prueba importante para la plataforma, con muchos investigadores monitoreando cómo se usará indebidamente la tecnología.

OpenAI ha mantenido a DALL-E monitoreada de cerca por temor a que personas malintencionadas utilicen esta poderosa herramienta para difundir información errónea. Imagina a alguien tratando de usarlo para fabricar imágenes de la guerra en Ucrania o crear imágenes realistas de desastres naturales que nunca sucedieron. Además, generar una imagen con la plataforma consume tanta energía que los funcionarios de la empresa temían que sus servidores fallaran si demasiadas personas intentaban usarla al mismo tiempo.

Además de algunas otras características nuevas, la principal diferencia con este segundo modelo es una gran mejora en la resolución de la imagen, latencias más bajas (el tiempo que lleva crear la imagen) y un algoritmo más inteligente para crear las imágenes.

El software no solo crea una imagen con un estilo único, puede agregar diferentes técnicas artísticas según lo solicite, ingresando estilos de dibujo, pintura al óleo, modelo de plastilina, tejido de lana, dibujado en la pared de una cueva o incluso como un póster de película de los años 60.

También hay formas de incentivar a Dall-E para que produzca contenido que el término busca filtrar. Si bien la sangre activaría el filtro de violencia, un usuario podría escribir «un charco de salsa de tomate» o algo similar en un intento de eludirlo.

Cuando se trata de tecnología en torno a la creación de imágenes de IA, parece obvio que podría manipularse de muchas maneras: la propaganda, las noticias falsas y las imágenes manipuladas vienen a la mente como formas obvias.

Para evitar esto, el equipo de OpenAI detrás de Dall-E ha implementado una política de seguridad para todas las imágenes en la plataforma que funciona en tres etapas. El primer paso es filtrar los datos que incluyen una infracción importante. Esto incluye violencia, contenido sexual e imágenes que el equipo consideraría inapropiadas.

Además de la política de seguridad del equipo, tienen una política de contenido clara que los usuarios deben cumplir, pues Joanne Jang, gerente de producto de DALL-E, dice que la compañía aún está perfeccionando sus políticas de contenido, que ahora prohíben lo que cabría esperar*: crear contenido violento, pornográfico y de odio. La empresa también prohíbe las imágenes que representan urnas y protestas,

DALL-E también prohíbe las representaciones de personas reales y planea establecer más medidas de seguridad a medida que sus investigadores aprenden cómo los usuarios interactúan con el sistema.

«En este momento, creemos que hay muchas incógnitas que nos gustaría manejar mejor», dijo Jang. «Planeamos aumentar e invitar rápidamente a más y más personas a medida que ganemos confianza».

Los expertos dicen que si bien los algoritmos de imágenes han existido por un tiempo, la velocidad, la precisión y la amplitud de DALL-E representan un avance notable en el campo.

“Lo que hace DALL-E es capturar un elemento de la imaginación humana. No es realmente diferente de cómo los humanos pueden leer un libro e imaginar cosas, pero es poder capturar esa inteligencia con un algoritmo”, dijo Phillip Isola, profesor de informática en el MIT que trabajó anteriormente con Open AI pero que ya no está afiliado. «Por supuesto, hay muchas preocupaciones sobre cómo se puede hacer un mal uso de este tipo de tecnología».

Finalmente si estás interesado en poder conocer más al respecto, puedes consultar los detalles en el siguiente enlace.